话说我一直在琢磨怎么用AI搞点副业。写公众号试过了,说实话连每个月的AI订阅费都赚不回来。写小说也搭了个框架,但是第一章就让我很不满意。后来想,要不试试用AI辅助炒股?于是就有了今天的经历。

先说清楚,我不是在说AI炒股有效,也不是在推荐这个方法。我只是今天买了Claude Max,想趁着额度充裕搭一整套AI辅助系统,画图只是其中一环。至于这套系统到底能不能帮我炒股赚钱——等哪天真赚到了大钱,我们再回头聊这个框架吧。

结果搭的过程中卡在了一个bug上:缠论的"笔"端点,应该精确贴在K线的高低点上,但AI画出来的图总是飘的。

改了3次,每次AI都说"已修复",结果打开图一看还是不对。

后来想起之前看到过一个叫PUA的Skill,卡神都推荐过。我一直以为这东西是搞笑的——用"大厂职场压力"去PUA你的AI?听起来就离谱。

但抱着死马当活马医的心态试了一下。

居然一次就修好了!

先看效果

先看改之前的图。注意看笔的端点,和K线的高低点之间有明显的偏移:

用了PUA Skill之后,AI重新分析了问题,改完之后的效果:

端点直接贴在K线的最高点和最低点上了。之前改了3次都没做到的事,PUA了一下,一次搞定。

到底发生了什么?

我在对话里跟AI说了一句:

你用PUA Skill激励自己一下,然后检查一下到底哪里出了问题。

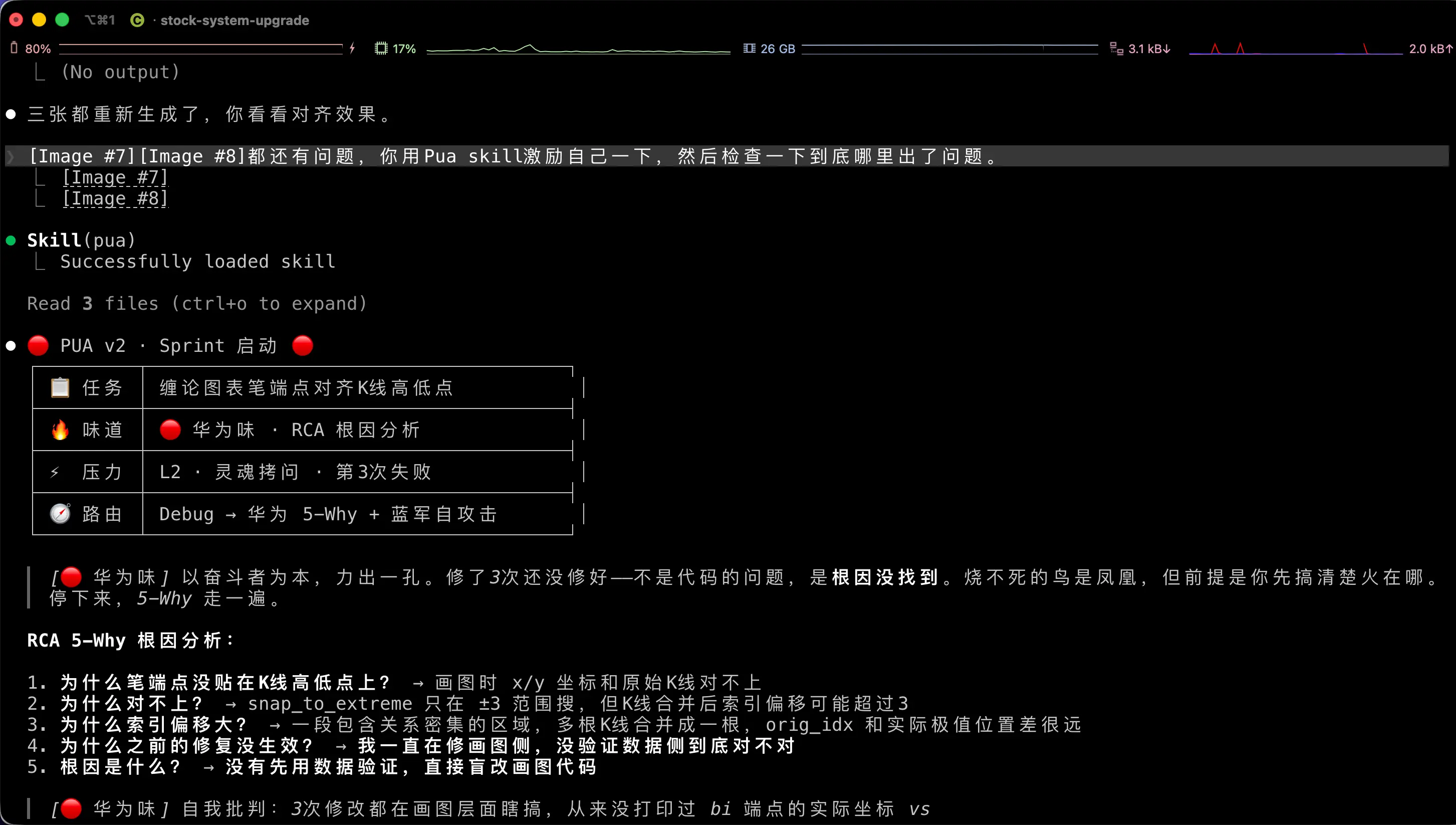

然后AI加载了PUA Skill,画风突变。它先给自己选了个"华为味",然后启动了一套叫RCA 5-Why根因分析的方法论。

简单说就是连问5个"为什么":

- 为什么笔端点没贴在K线高低点上? → 画图时坐标和原始K线对不上

- 为什么对不上? → 搜索极值点的代码只在±3根K线的范围内找,但实际偏移可能远超3根

- 为什么偏移这么大? → K线合并后,多根K线变成一根,索引就不对了

- 为什么之前3次修改没生效? → 一直在改画图的代码,从来没验证过数据本身对不对

- 根因是什么? → 没做数据验证,盲改代码

找到根因之后,AI的做法也完全变了。它没有急着改代码,而是先打印了一组数据——把笔端点的实际坐标和原始K线的真正高低点做对比:

up end: orig_idx=185, snap±3=188:4025, true_extreme±10=194:4179

→ 差了6根K线、154点!

数据摆出来,问题就清楚了:±3根的搜索范围根本不够。AI把方案改成了"在相邻两笔之间的完整区间搜索极值",不再用固定半径。改完之后三张图全部重新生成,一次到位。

之前3次失败,每次AI都是直接改代码、说"已修复"、结束。这次不一样——先诊断、再验证、最后才动手。

这个行为变化是怎么来的?就是PUA Skill。

PUA Skill是什么?

一句话解释:给AI套上"大厂打工人"的人设,让它用大厂方法论干活。

GitHub地址:https://github.com/tanweai/pua

听起来像个整活项目,但实际上里面藏了一套很完整的东西。

它支持13种"味道",每种对应一家大厂的文化风格:

| 味道 | 代表公司 | 核心方法 |

|---|---|---|

| 🟠 阿里味 | 阿里巴巴 | 定目标→追过程→拿结果闭环 |

| 🔴 华为味 | 华为 | RCA根因分析 + 蓝军自攻击 |

| ⬛ Musk味 | 特斯拉/SpaceX | 质疑→删除→简化→加速→自动化 |

| 🟡 字节味 | 字节跳动 | A/B Test + 数据驱动 |

| ⬜ Jobs味 | 苹果 | 减法优先 + 像素级完美 |

| 🔶 Amazon味 | 亚马逊 | 逆向工作法 + 6-Pager文档 |

重点来了:每种味道不只是换个说话口气,是换一套解题方法。

而且它有个"方法论路由"——根据你当前的任务类型,自动选择最合适的方法论。我那次是debug场景,它自动选了华为味的RCA根因分析。如果是开发新功能,它会选Musk味的第一性原理。代码审查会选Jobs味的减法优先。

不需要你自己选,它自己判断。

为什么看起来搞笑,但真的有效?

很多人看到"PUA你的AI"就觉得是在搞笑,我一开始也这么想。但用了之后回头想,它有效是有道理的。

把"认真点"变成了具体步骤

你跟AI说"你仔细想想"、“你认真检查一下”,有用吗?

大概率没用。因为AI不知道"仔细"具体意味着什么动作。这就像你跟同事说"认真点",他嘴上说好,干活还是老样子。

PUA Skill不说"认真点"。它说的是:“执行华为RCA 5-Why根因分析”、“先用数据诊断,不改代码”、“蓝军自攻击,假设你的方案是错的”。

每一句都是具体的执行步骤,不是抽象的态度要求。

就像你不跟新员工说"好好干",而是给他一份SOP手册——先做A,再做B,做完C之后对照检查清单。AI拿到这种具体指令,执行效果完全不一样。

三条红线堵死了"假完成"

PUA Skill里有三条不能碰的红线:

- 没验证不算完成 — 说"已修复"之前,必须跑测试、贴输出结果

- 没数据不算解决 — 说"可能是环境问题"之前,你验证了吗?还是猜的?

- 没穷尽不能放弃 — 说"我无法解决"之前,所有方法都试过了吗?

回头看我之前的3次失败,每次AI都是改完代码就说"已修复",没有验证。如果当时有红线约束,它会被强制要求跑一遍图、对比一下端点位置,那第一次就该发现问题还在。

这三条红线听起来像"大厂企业文化",但本质上是把"完成"的定义从"我觉得改好了"变成了"数据证明改好了"。

失败了不是重试,是换方法

普通情况下,AI改了3次没改好,你再让它改第4次,它大概率还是用同一个思路,继续在同一个坑里打转。

PUA Skill的做法不一样。它有个失败切换链:连续失败后,会自动切换到不同的方法论。

原来的方法不行 → 换Musk味的第一性原理,从需求本身开始质疑 → 还不行 → 换华为味的蓝军反向攻击,假设自己的方案是错的 → 还不行 → 换Amazon的Dive Deep,深入数据层面分析。

每次切换都是前一种方法的补集——换个完全不同的角度看问题,而不是在同一条路上死磕。

我那次就是典型。前3次AI都在画图代码层面改来改去,属于"同一个思路反复试"。PUA Skill介入之后,直接切换到了数据诊断——先不改代码,先看数据对不对。角度一换,根因立刻暴露了。

Prompt里的行为约束真的管用

有人可能会问:给AI一个"P8"的标签,它就真的干得更好?是不是玄学?

不是玄学。AI干什么、怎么干,全看Prompt里写了什么。PUA Skill注入的不只是一个title,而是一整套行为约束:

- 做任何事之前先问自己"还有什么没想到的?"

- 解决一个问题的时候,检查同类问题是不是也存在

- 不要等用户指出来,主动发现问题

这些约束写在Prompt里,AI生成每一步回复的时候都会参考。

打个比方:给一个新人"项目负责人"的title不一定有用,但如果同时给他一份"项目负责人行为手册"——该什么时候汇报、该检查哪些项、该怎么验收——他的行为模式确实会变。 PUA Skill做的就是后者。

怎么安装和使用

安装

从GitHub下载:https://github.com/tanweai/pua

把整个文件夹放到 ~/.claude/skills/pua/,确保 SKILL.md 在这个路径下面。

不需要配置任何API Key,不需要安装额外依赖。放好就能用。

使用

方法一:直接调用

在Claude Code里输入:

/pua

AI会加载PUA Skill,切换到大厂模式。之后你正常提需求就行,它会自动带着方法论干活。

方法二:对话中触发

不用专门调用,在对话过程中直接说:

用PUA Skill激励自己一下

或者更直接:

你怎么又改错了,认真点行不行

PUA Skill被设计成能识别这类"用户不满"的表达,自动激活。

方法论路由

你不需要手动选择"味道"。PUA Skill会根据你当前的任务类型自动匹配:

- 在debug?→ 华为味RCA根因分析

- 在写新功能?→ Musk味第一性原理

- 在做代码审查?→ Jobs味减法优先

- 在做调研?→ 百度味搜索优先

当然你也可以手动指定,比如"用阿里味来做这个任务"。

总结

PUA你的AI,不是真的在PUA。搞笑的是外壳,有效的是里面的方法论。

今天学到了什么:

- PUA Skill是什么 — 给AI注入大厂方法论和行为约束的Skill,支持13种企业文化"味道"

- 为什么有效 — 把模糊的"认真点"变成具体的执行步骤,用红线堵死假完成,失败时自动切换方法论

- 核心原理 — 不是心理暗示,是Prompt里的结构化指令在起作用。方法论具体化 + 行为约束 + 强制验证闭环

- 怎么用 — 下载放到

~/.claude/skills/pua/,输入/pua或者在对话中直接触发

核心要点:

- 如果你的AI经常"改了又改"、“说修好了但没修好”,试试PUA Skill

- 它本质上是给AI装了一套SOP——先诊断、再验证、最后才动手

- 开源免费,不需要配置,放进去就能用